速報

社会

福島第1原発2号機、使用済み燃料プールからの燃料取り出し開始 全615体を28年度までに搬出

東京電力は6月2日、福島第1原発2号機の使用済み核燃料プールから燃料を取り出す作業を開始。全615体を2028年度までに共用プールへ移し、安定保管を目指す。1~4号機で3基目の取り出し。

芸能

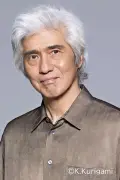

斉藤慎二被告「女性が好意あると認識」不同意性交罪で無罪主張

お笑いトリオ「ジャングルポケット」元メンバー斉藤慎二被告の不同意性交等罪公判が東京地裁で行われ、被告は女性の好意を感じ同意があったと主張した。起訴内容はロケバス内での性的暴行。

スポーツ

大谷翔平、2試合連続複数安打!緩いゴロも全力疾走で内野安打

ドジャース大谷翔平がダイヤモンドバックス戦で4打数3安打の活躍。2試合連続複数安打で、緩いゴロも全力疾走し内野安打を記録。チームは1-4で敗戦。

経済

国際

政治

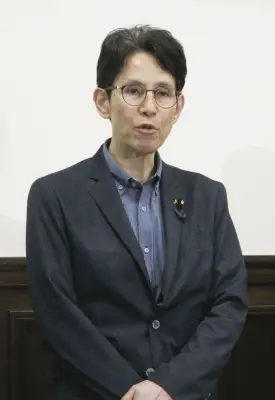

小沢一郎氏「命ある限り政治活動」次期衆院選出馬は明言せず

前衆院議員の小沢一郎氏(84)が5月31日、岩手県花巻市で後援会役員会を開き、「命ある限り政治活動を続ける」と表明。次期衆院選への出馬は明言せず、野党の現体制では勝てないと指摘した。

日本国旗損壊罪法案、3党が慎重対応確認

中道改革連合、立憲民主、公明3党の幹事長が会談し、自民党提出の日本国旗損壊罪法案に慎重対応を確認。中道の階幹事長は立法事実の説明不足を批判。補正予算案では3党で審議連携を確認。

科学

最新情報を受け取る

ニュースレターに登録して、最新ニュースをメールで受け取りましょう!

スパムは一切送信しません