速報

社会

佐賀県警元職員のDNA鑑定不正、計239件に 警察庁が新たに110件認定

佐賀県警の科捜研元職員によるDNA型鑑定不正問題で、警察庁は新たに110件の不適切鑑定を認定し、総計239件に上ると発表。県警の当初調査は不十分と指摘した。

芸能

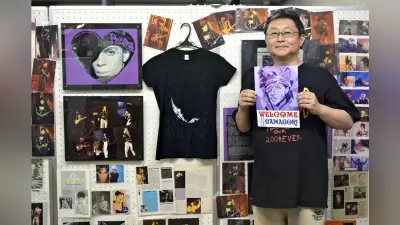

プリンス研究第一人者が収集した約250点のコレクション展 愛知・蒲郡で開催

プリンス研究の第一人者、愛知県蒲郡市職員の水野弘淳さんが収集した約250点のコレクションを展示する企画展が同市立図書館で開催中。激動の円熟期を資料と試聴で紹介。

スポーツ

大谷翔平が二刀流で先発、鈴木誠也が8号ソロ 岡本和真と吉田正尚も安打

大谷翔平がダイヤモンドバックス戦に二刀流で先発し一回を三者凡退、打撃でも内野安打。鈴木誠也は8号ソロ、岡本和真と吉田正尚も安打を記録。

経済

福井・大野市の財政自立度低迷、持続可能な財源確保が課題に 市長選で問われるリーダーシップ

福井県大野市の財政力指数が県内最低の0.42と低迷。経常収支比率も94%に上昇し、自由財源が減少。市長選では持続可能な財源確保や企業誘致など、トップの実行力が問われる。

地域

政治

首相、消費減税巡り「結論先取りせず」検討継続

高市早苗首相は4日の衆院予算委員会で、飲食料品の消費税減税について「諸課題の克服に向けた検討を進めている」と述べ、結論を先取りしない考えを示した。政府内では税率1%案が浮上している。

自民、憲法改正国民投票法審議を提案 中道はCM規制議論を前提

衆院憲法審査会で、自民党が国民投票法改正案の早期審議を提案。中道改革連合はCMやネット広告、運動資金規制の議論が前提と強調。AI対策や広報協議会の在り方も討議。

板橋区長選に船本優月氏が出馬表明

来年の東京都板橋区長選に、電力会社社員の船本優月氏(34)が出馬表明。地域政党「再生の道」公認で都議選に挑戦後、地域団体を立ち上げ活動。区政の新たなロールモデルを目指す。

伊藤英明さん会長の織田家顕彰奉賛会発足

戦国武将・織田信長の生誕500年(2034年)に向け、信長とその弟・有楽斎の功績を伝える「織田家顕彰奉賛会」が岐阜市で発足。会長には俳優の伊藤英明さんが就任し、地域文化の振興を目指す。

科学

最新情報を受け取る

ニュースレターに登録して、最新ニュースをメールで受け取りましょう!

スパムは一切送信しません